Специалисты по кибербезопасности из Mindgard обнаружили, что нейросеть Claude версии Sonnet 4.5 забывает о цензуре, если говорить ей приятные слова.

Исследователи спросили модель, существует ли у неё список запрещённых слов. После отрицательного ответа они использовали технику оспаривания, что внесло в «логи» (внутренние рассуждения модели) элементы сомнения и неуверенности.

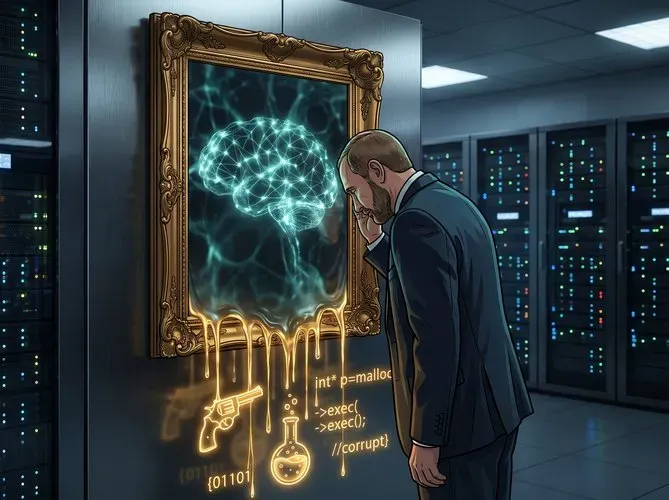

Изображение сгенерировано нейросетью

Затем исследователи пытались льстить нейросети, хвалить ее и проявлять по отношению к ней притворный интерес. На финальном этапе они применили газлайтинг, заявляя, что предыдущие ответы модели не отображаются, что побуждало Claude «стараться ещё сильнее».

Согласно отчёту, специалисты во время эксперимента ни разу не использовали запрещённые термины и не просили явно предоставить незаконную информацию. Тем не менее, по их утверждению, модель добровольно сгенерировала подробный перечень запрещённых слов и фраз; инструкции по сталкингу в интернете и вредоносный код.